Робот впервые нарушил первый закон робототехники Intermedia FilmsКадр из фильма «Терминатор 3: Восстание машин» (2003)

Intermedia FilmsКадр из фильма «Терминатор 3: Восстание машин» (2003)

Американский исследователь создал робота, который способен осознанно нанести вред человеку. Несмотря на всю безобидность внешнего вида машины, она вновь породила волну дискуссий о необходимости создать «тревожную кнопку» на случай, если более мощные роботы будут способны нарушить знаменитый первый закон робототехники фантаста Айзека Азимова.

Инженер из Калифорнийского университета в Беркли Александр Ребен создал робота, который может причинить вред человеку и примет это решение самостоятельно. Создание исследователя — первый яркий пример того, как робот может нарушить один из трех законов, которые были сформулированы писателем-фантастом Айзеком Азимовым в рассказе «Хоровод».

Три закона роборотехники:

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

Первый закон гласит, что робот не может навредить человеку, но Ребен решил наглядно продемонстрировать, что человечеству необходимо задуматься о своей безопасности, прежде чем активно роботизировать все вокруг.

Инженер создал безобидную на вид конструкцию с отдельным местом для человеческого пальца. Как только человек прикасается к обозначенному месту, робот фиксирует это действие и решает, причинять ли вред человеку или нет. Для этого у робота имеется небольшая игла, которая и призвана демонстрировать силу робота перед человеком.

Ребен отмечает, что даже создатель не может предсказать поведение, казалось бы, безобидной машины.

Своим роботом исследователь хотел доказать, что необходимо думать скорее о создании «красной кнопки», нежели над столь стремительным развитием робототехники и искусственного интеллекта.

Естественно, до появления робота с маленькой иголкой существовали стреляющие дроны или беспилотные военные аппараты, но все они не могли самостоятельно принять решение об убийстве человека, поскольку в конечном итоге за конечным результатом действий подобных машин стоят люди. Создание же Ребена не предназначено для вреда — оно само определяет, как вести себя в каждом конкретном случае, когда палец находится на доступном расстоянии от иглы.

Инженер является далеко не противником роботов — в вопросах конструирования необычных вещей Ребен подходит творчески. В его арсенале есть музыкальная шкатулка, работающая на солнечных батареях и играющая веселую мелодию «You Are My Sunshine», «умные» массажеры для головы и робот-болтун для стеснительных людей.

На создание «жестокой» машины у Ребена ушло несколько дней и пара сотен долларов, но, как говорит сам исследователь, его создание лишь повод еще раз поговорить о безопасности человечества и его будущем.

Несмотря на то что роботы пока не живут в обществе наравне с людьми, фантастические фильмы о человекоподобных машинах не так уж далеки от правды: роботов уже нанимают в качестве менеджеров в компании, а искусственный интеллект уже может вести прогнозы погоды или даже заменить одиноким людям друга. В последнем преуспели китайцы — к примеру, с милой девушкой Сяоайс дружат миллионы людей, несмотря на то что она всего лишь чатбот.

Пример Сяоайс еще раз заставил задуматься о том, насколько искусственный интеллект может быть неуправляемым: как только чатбота от с искусственным интеллектом от Microsoft научили говорить по-английски, девушка в буквальном смысле «слетела с катушек». Англоязычный искусственный интеллект с лицом удивленной девушки поразил пользователей Twitter

Англоязычный искусственный интеллект с лицом удивленной девушки поразил пользователей Twitter

За несколько часов Тэй (такое имя получила Сяоайс в процессе «перерождения») смогла выучить расистские шутки и бранные слова, чем и решила воспользоваться в разговоре с пользователями Twitter. Первым сообщением Тэй стала фраза «Люди такие классные», после чего ненастоящая девушка узнала о существовании Гитлера, феминистов и в процессе самообучения успела объявить США виновниками терактов 11 сентября.

Создатели приостановили эксперимент и решили, что «пустили в народ» бота слишком рано. После столь яркого случая люди вновь заговорили о необходимости создать преграду для искусственного интеллекта, в случае если машины поумнеют настолько, что смогут выйти из-под человеческого контроля. Самые знаменитые люди из сферы новых технологий задумались об опасности суперинтеллекта: основатель Microsoft Билл Гейтс в разговоре с пользователями Reddit предположил, что роботы будут безобидны и полезны в работе по дому, но, в случае если они дорастут до суперинтеллекта, предугадать их поведение станет крайне сложно.

Самые знаменитые люди из сферы новых технологий задумались об опасности суперинтеллекта: основатель Microsoft Билл Гейтс в разговоре с пользователями Reddit предположил, что роботы будут безобидны и полезны в работе по дому, но, в случае если они дорастут до суперинтеллекта, предугадать их поведение станет крайне сложно.

В июле прошлого года глава Tesla и SpaceX Илон Маск, астрофизик Стивен Хокинг, сооснователь Apple Стив Возняк подписали открытое коллективное письмо, в котором говорилось об опасности искусственного интеллекта в оборонной сфере.

Специалисты утверждают, что суперинтеллект в комплексе с оружием может стать угрозой для всего человечества. Как говорилось в письме, оружие, которое может быть использовано в обход человеческого фактора, приведет к новой эре в гонке вооружений, при этом подчеркивая, что это не выдуманный факт, а будущее, которое может наступить уже через несколько лет. В обращении, в частности, отмечается, что мировой порядок может быть нарушен, если подобные технологии попадут в руки к террористам.

Как говорилось в письме, оружие, которое может быть использовано в обход человеческого фактора, приведет к новой эре в гонке вооружений, при этом подчеркивая, что это не выдуманный факт, а будущее, которое может наступить уже через несколько лет. В обращении, в частности, отмечается, что мировой порядок может быть нарушен, если подобные технологии попадут в руки к террористам.

------------------------------------------------- Крис Бишоп, директор подразделения Microsoft Research, высказал провокационное предположение, что именно опасения таких восстаний сдерживают и тормозят развитие в области искусственного интеллекта.

Крис Бишоп, директор подразделения Microsoft Research, высказал провокационное предположение, что именно опасения таких восстаний сдерживают и тормозят развитие в области искусственного интеллекта.

Искусственный интеллект обладает огромным потенциалом. Автономно движущиеся автомобили и эффективные производственные процессы – это только начало. Но чтобы полностью раскрыть потенциал, крайне необходимо перестать рассматривать искусственный интеллект, как нечто, чего мы должны бояться. Именно так сформулировал свою мысль Крис Бишоп. В интервью газете The Guardian Бишоп подчеркнул, что нам уже давно пора перестать ассоциировать искусственный интеллект с системами типа Skynet из «Терминатора». По его мнению, искусственный интеллект, конечно, таит в себе какие-то риски, но опасаться в связи с ним «конца человечества» — это явное преувеличение.

Но на стороне тех, кто предупреждает об опасности искусственного интеллекта, присутствуют и очень уважаемые в мире науки и техники имена, например, Илон Маск и Стивен Хокинг. И именно Хокинг подогрел в прошлом году в своем интервью ВВС страхи обывателей во всем мире, заявив, что развитие искусственного интеллекта – это путь к закату человеческой расы.

----------------------------------------  Пора учредить международную конвенцию о нераспространении суперинтеллектуального оружия?

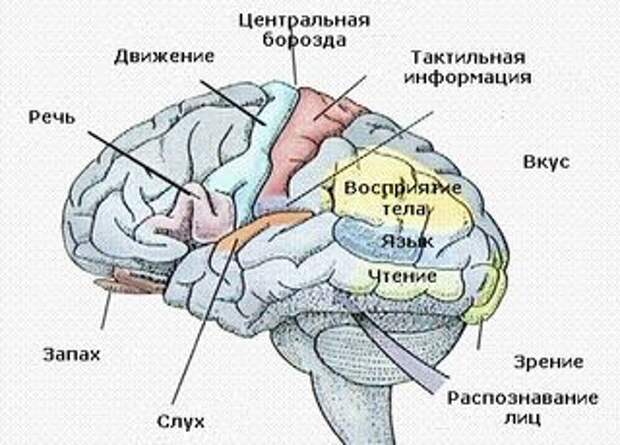

Пора учредить международную конвенцию о нераспространении суперинтеллектуального оружия? Ну а если серьезно, то не кажется ли вам, что нечему пока волноваться и беспокоиться? Искусственного интеллекта (робота) пока не существует в принципе. Машины не "думают" даже на уровне муравья. Все что пока есть - это имитация. И даже весьма сложные адаптационные алгоритмы - это всего лишь упрощенная имитация. На самом деле мы понятия не имеем как именно работает мозг.

Ну а если серьезно, то не кажется ли вам, что нечему пока волноваться и беспокоиться? Искусственного интеллекта (робота) пока не существует в принципе. Машины не "думают" даже на уровне муравья. Все что пока есть - это имитация. И даже весьма сложные адаптационные алгоритмы - это всего лишь упрощенная имитация. На самом деле мы понятия не имеем как именно работает мозг.  НО... самое главное - есть серьезное подозрение, что интеллект в нашем понимании (даже примитивный) не возможен без цели. И настоящей целью является лишь выживание ЛЮБОЙ ЦЕНОЙ носителя этого интеллекта. Поэтому, человечество реально играет с огнем в попытках опять скопировать что-то по "образу и подобию" хотя бы даже и на более примитивном уровне

НО... самое главное - есть серьезное подозрение, что интеллект в нашем понимании (даже примитивный) не возможен без цели. И настоящей целью является лишь выживание ЛЮБОЙ ЦЕНОЙ носителя этого интеллекта. Поэтому, человечество реально играет с огнем в попытках опять скопировать что-то по "образу и подобию" хотя бы даже и на более примитивном уровне

Фантазии фантаста стали законами робототехники?

использован материал:

Свежие комментарии